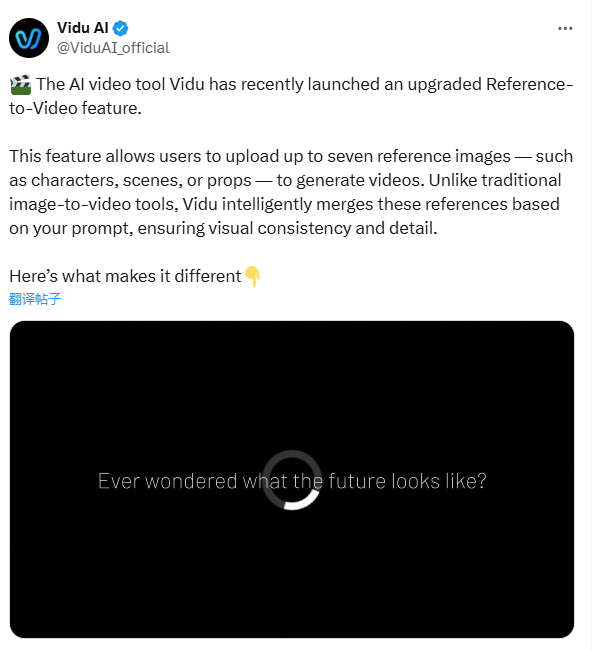

中国AI视频生成领域领军者Vidu近日宣布,其Q1模型迎来重大升级,推出了全新的“参考转视频”(Reference-to-Video)功能,允许用户上传最多七张参考图像,生成视觉一致性极高的1080p视频。这一功能突破了传统AI视频生成在多场景和多主体一致性上的瓶颈,为创作者提供了前所未有的灵活性和创作自由。

参考转视频:七张图像解锁复杂叙事

Vidu Q1的“参考转视频”功能是此次更新的核心亮点。用户可上传最多七张参考图像,包括人物、场景、道具等元素,结合文本提示词生成高质量视频。Vidu Q1通过先进的语义融合技术,确保多张图像中的元素在视频中保持高度一致,避免了传统AI视频生成中常见的场景断裂或角色失真问题。

例如,用户可上传一张人物照片、一张森林背景和一张动物图像,输入提示词:“一名女性在森林中弹吉他,猫头鹰停在树枝上。”Vidu Q1能够智能生成包含吉他演奏动作、森林环境和猫头鹰的视频,画面细节如服装纹理、背景光影和动物动作均高度逼真。这一功能为动画、短视频和广告创作者提供了强大的工具,显著降低了复杂场景的制作门槛。

多主体一致性:打造连贯视觉体验

Vidu Q1的多主体一致性(Multiple-Entity Consistency)技术是其核心竞争力之一。用户可通过上传不同类型的参考图像(如角色、物体、环境),生成包含多主体互动的视频,且每个主体的特征在整个视频中保持稳定。例如,上传一张角色照片、一件花纹服装和一辆自行车图片,Vidu Q1可生成一段角色穿着指定服装、骑行自行车的流畅视频,细节如花纹和自行车造型均与参考图像高度吻合。

与上一代模型相比,Q1在画面细节和动作流畅度上显著提升,支持多角度镜头切换和动态场景过渡,确保360°视角下的视觉一致性。这一功能尤其适合动漫、游戏预告片和虚拟场景模拟等需要复杂叙事的场景,为专业创作者提供了接近传统影视制作的创作体验。